GPT-4Детаљи који су процурили бацају светло на његове огромне размере и импресивну архитектуру

Укратко

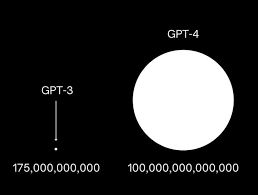

Процуреле информације о GPT-4 изазвао је узбуђење међу АИ заједницом. Са преко 10 пута већим параметрима од свог претходника, GPT-3, GPT-4 процењује се да има 1.8 трилиона параметара распоређених на 120 слојева.

OpenAI имплементирао модел мешавине стручњака (МоЕ), користећи 16 стручњака са 111 милијарди параметара за вишеслојне перцептроне (МЛП). Ефикасан процес закључивања модела користи 280 милијарди параметара и 560 ТФЛОПс по пролазу унапред, демонстрирајући OpenAIПосвећеност компаније максимизирању ефикасности и исплативости. Скуп података за обуку модела укључује 13 трилиона токена, са финим подешавањем од 8к до 32к.

OpenAI користио паралелизам у GPT-4 да искористе пуни потенцијал својих А100 ГПУ-а, користећи 8-смерни тензорски паралелизам и 15-смерни паралелизам цевовода. Процес обуке је био обиман и захтевао је много ресурса, а трошкови су се кретали од 32 милиона до 63 милиона долара.

GPT-4Трошак закључивања је отприлике три пута већи од његовог претходника, али такође укључује пажњу на више упита, континуирано груписање и спекулативно декодирање. Архитектура закључивања ради на групи од 128 ГПУ-а, распоређених у више центара података.

Недавно цурење детаља око GPT-4 је послала шокове кроз АИ заједницу. Информације које су процуриле, добијене из неоткривеног извора, пружају увид у могућности које изазивају страхопоштовање и невиђене размере овог револуционарног модела. Раставићемо чињенице и открити кључне аспекте који чине GPT-4 право технолошко чудо.

- GPT-4'с Массиве Параметерс Цоунт

- Модел мешавине стручњака (МоЕ)

- Поједностављени алгоритам рутирања МОЕ

- Еффициент Инференце

- Обимни скуп података за обуку

- Прецизност кроз фино подешавање од 8К до 32К

- Скалирање са ГПУ-овима преко паралелизма

- Трошкови обуке и изазови коришћења

- Компромиси у мешавини стручњака

- Инференце Цост

- Мулти-Куери Аттентион

- Цонтинуоус Батцхинг

- Висион Мулти-Модал

- Спекулативно декодирање

- Инференце Арцхитецтуре

- Величина и састав скупа података

- Гласине и спекулације

- Репортерово мишљење

- Тхе Фасцинатион витх GPT-4'с Кновледге

- Свестраност оф GPT-4

GPT-4'с Массиве Параметерс Цоунт

Једно од најупечатљивијих открића цурења је сама величина GPT-4. Може се похвалити задивљујућом величином, са више од 10 пута већим параметрима од свог претходника, GPT-3. Процењује се да има запањујућих укупно око 1.8 трилиона параметара распоређених на импресивних 120 слојева. Ово значајно повећање обима несумњиво доприноси GPT-4'с побољшане могућности и потенцијал за револуционарни напредак.

Модел мешавине стручњака (МоЕ)

Да бисте обезбедили разумне трошкове уз одржавање изузетних перформанси, OpenAI имплементирао модел мешавине стручњака (МоЕ) у GPT-4. Коришћењем 16 стручњака у оквиру модела, од којих се сваки састоји од око 111 милијарди параметара за вишеслојне перцептроне (МЛП), OpenAI ефективно оптимизована алокација ресурса. Приметно је да се током сваког пролаза унапред, само два стручњака рутирају, што минимизира рачунске захтеве без угрожавања резултата. Овај иновативни приступ показује OpenAI'с посвећеност максимизирању ефикасности и исплативости у својим моделима.

Веома занимљиво и детаљно цурење GPT-4 архитектуре, са одличном анализом разлога који стоје иза ње и њених импликација – од @дилан522п :https://t.co/eHE7VlGY5V

— Јан П. Харис (@јпхме) Јула КСНУМКС, КСНУМКС

Сажетак који није плаћени може се наћи овде: https://t.co/rLxw5s9ZDt

Поједностављени алгоритам рутирања МОЕ

Док модел често истражује напредне алгоритме рутирања за одабир стручњака који ће руковати сваким токеном, OpenAIприступ у актуелном GPT-4 модел је наводно једноставнији. Алгоритам рутирања који користи АИ наводно је релативно једноставан, али ипак ефикасан. Приближно 55 милијарди заједничких параметара за пажњу олакшава ефикасну дистрибуцију токена одговарајућим стручњацима у оквиру модела.

Еффициент Инференце

GPT-4Процес закључивања показује његову ефикасност и моћ рачунања. Сваки пролаз унапред, посвећен генерисању једног токена, користи приближно 280 милијарди параметара и 560 ТФЛОП-а (тера операција са покретним зарезом у секунди). Ово је у потпуној супротности са огромним размерама GPT-4, са својих 1.8 трилиона параметара и 3,700 ТФЛОП-а по пролазу унапред у чисто густом моделу. Ефикасна употреба ресурса истиче OpenAIпосвећеност постизању оптималних перформанси без превеликих рачунарских захтева.

Обимни скуп података за обуку

GPT-4 је обучен на колосалном скупу података који се састоји од приближно 13 трилиона токена. Важно је напоменути да ови токени укључују и јединствене токене и токене који рачунају бројеве епохе. Тхе тренажни процес укључује две епохе за текстуалне податке и четири епохе за податке засноване на коду. OpenAI користи милионе редова података за фино подешавање инструкција добијених из СцалеАИ и интерно да побољша перформансе модела.

Прецизност кроз фино подешавање од 8К до 32К

Фаза предобуке за GPT-4 користи дужину контекста од 8к. Након тога, модел је прошао фино подешавање, што је резултирало верзијом од 32к. Овај напредак се заснива на фази пре обуке, побољшавајући могућности модела и прилагођавајући га специфичним задацима.

Скалирање са ГПУ-овима преко паралелизма

OpenAI искористио моћ паралелизма у GPT-4 да искористе пуни потенцијал својих А100 ГПУ-ова. Користили су 8-смерни тензорски паралелизам, који максимизира паралелну обраду, јер је то граница за НВЛинк. Поред тога, коришћен је 15-смерни паралелизам цевовода за даље побољшање перформанси. Иако су специфичне технике као што је ЗеРо Стаге 1 вероватно коришћене, тачна методологија остаје неоткривена.

Трошкови обуке и изазови коришћења

тренинг GPT-4 био обиман подухват који је захтевао велике ресурсе. OpenAI доделио приближно 25,000 А100 ГПУ-а у периоду од 90 до 100 дана, који раде са стопом искоришћења од приближно 32% до 36% МФУ (најчешће коришћени). Процес обуке је довео до бројних неуспеха, што је захтевало честа поновна покретања са контролних пунктова. Ако се процењује на 1 УСД по А100 сату, трошкови обуке само за ову трку би износило око 63 милиона долара.

Компромиси у мешавини стручњака

Примена модела мешавине стручњака представља неколико компромиса. У случају GPT-4, OpenAI опредијелили за 16 стручњака умјесто већег броја. Ова одлука одражава равнотежу између постизања супериорних резултата губитка и обезбеђивања генерализације у различитим задацима. Више стручњака може представљати изазове у смислу генерализације и конвергенције задатака. OpenAI'с избор за вежбање опрез у стручном избор је у складу са њиховом посвећеношћу поузданим и робусним перформансама.

Инференце Цост

У поређењу са својим претходником, Давинчијевим моделом од 175 милијарди параметара, GPT-4Трошкови закључивања су отприлике три пута већи. Ово неслагање се може приписати неколико фактора, укључујући веће кластере потребне за подршку GPT-4 а нижа искоришћеност постигнута током закључивања. Процене указују на приближну цену од 0.0049 центи за 1,000 токена за 128 А100 ГПУ-а и 0.0021 цента за 1,000 токена за 128 Х100 ГПУ-а када се закључи GPT-4 са 8к. Ове бројке претпостављају пристојну искоришћеност и велике количине серија, што је кључно за оптимизацију трошкова.

Мулти-Куери Аттентион

OpenAI користи пажњу на више упита (МКА), технику која се широко користи у овој области, у GPT-4 такође. Имплементацијом МКА, модел захтева само једну главу, што значајно смањује капацитет меморије неопходан за кеш кључ/вредност (КВ кеш). Упркос овој оптимизацији, треба напоменути да је серија од 32к GPT-4 не може да се постави на 40ГБ А100 ГПУ, а 8к је ограничено максималном величином серије.

Цонтинуоус Батцхинг

Да бисте успоставили равнотежу између кашњења и трошкова закључивања, OpenAI укључује и променљиве величине серија и континуирано дозирање GPT-4. Овај прилагодљиви приступ омогућава флексибилну и ефикасну обраду, оптимизујући коришћење ресурса и смањење трошкова рачунара.

Висион Мулти-Модал

GPT-4 уводи посебан кодер за вид поред енкодера текста, који садржи унакрсну пажњу између њих. Ова архитектура, која подсећа на Фламинго, додаје додатне параметре већ импресивном броју параметара од 1.8 трилиона GPT-4. Модел визије пролази кроз одвојено фино подешавање коришћењем приближно 2 трилиона токена након фазе пре-тренинга само за текст. Ова способност визије оснажује аутономни агенти читати веб странице, транскрибовати слике и тумачити видео садржај — непроцењиво богатство у доба мултимедијалних података.

Спекулативно декодирање

Занимљив аспект GPT-4Стратегија закључивања је могућа употреба спекулативног декодирања. Овај приступ укључује употребу мањег, бржег модел да унапред генеришете предвиђања за више токена. Ови предвиђени токени се затим уносе у већи модел „пророчишта“ као једна серија. Ако је мањи предвиђања модела у складу са споразумом већег модела, неколико токена може бити декодирано заједно. Међутим, ако већи модел одбије токене предвиђене нацртом модела, остатак серије се одбацује, а закључивање се наставља само са већим моделом. Овај приступ омогућава ефикасно декодирање уз потенцијално прихватање секвенци ниже вероватноће. Вреди напоменути да ова спекулација у овом тренутку остаје непроверена.

Инференце Арцхитецтуре

GPT-4Процес закључивања ради на групи од 128 ГПУ-а, распоређених у више центара података на различитим локацијама. Ова инфраструктура користи 8-смерни тензорски паралелизам и 16-смерни паралелизам цевовода како би се максимизирала рачунарска ефикасност. Сваки чвор, који се састоји од 8 ГПУ-а, прихвата приближно 130 милијарди параметара. Са величином модела од 120 слојева, GPT-4 може да стане у 15 различитих чворова, вероватно са мање слојева у првом чвору због потребе да се израчунају уградње. Ови архитектонски избори олакшавају закључивање високих перформанси, демонстрирајући OpenAIпосвећеност померању граница рачунарске ефикасности.

Величина и састав скупа података

GPT-4 био је обучен на импресивних 13 трилиона токена, што му је пружило опсежан корпус текста за учење. Међутим, не могу се сви токени објаснити познатим скуповима података који се користе током обуке. Док скупови података као што су ЦоммонЦравл и РефинедВеб доприносе значајном делу подаци о обуци, остаје део токена за који се не води рачуна, често се назива „тајним“ подацима.

Гласине и спекулације

Појавиле су се спекулације о пореклу ових неоткривених података. Једна гласина сугерише да укључује садржај са популарних платформи као што су Твиттер, Реддит и ИоуТубе, наглашавајући потенцијални утицај садржаја који генеришу корисници на обликовање GPT-4база знања. Поред тога, постоје претпоставке око укључивања експанзивних колекција као што је ЛибГен, складиште милиона књига, и Сци-Хуб, платформа која омогућава приступ бројним научним радовима. Појам да GPT-4 био обучен на целом ГитХуб-у је такође кружио међу АИ ентузијастима.

Репортерово мишљење

Иако постоји много гласина, важно је приступити овим гласинама са опрезом. Обука за GPT-4 можда су имали велике користи од посебног скупа података састављеног од уџбеника за колеџ. Овај скуп података, који покрива широк спектар курсева и предмета, могао је бити пажљиво састављен ручно. Уџбеници за факултете пружају структурирану и свеобухватну базу знања која се може успешно користити за обуку језичког модела и лако се претварају у текстуалне датотеке. Укључивање таквог скупа података могло би оставити утисак да GPT-4 је образован у разним областима.

Тхе Фасцинатион витх GPT-4'с Кновледге

Један интригантан аспект GPT-4Обука компаније је његова способност да покаже познавање одређених књига, па чак и да се сети јединствених идентификатора са платформи као што је Пројецт Еулер. Истраживачи су покушали да извуку напамет научене делове књига GPT-4 да стекне увид у његову обуку, додатно подстичући радозналост о унутрашњем раду модела. Ова открића наглашавају задивљујућу способност GPT-4 да задржи информације и нагласи импресивне могућности великих језичких модела.

Свестраност оф GPT-4

Широк спектар тема и области које GPT-4 наизглед може да се бави излозима својом свестраношћу. Било да се ради о одговарању на сложена питања из рачунарства или удубљивању у филозофске дебате, GPT-4Обука корисника о разноврсном скупу података га оспособљава за интеракцију са корисницима из различитих домена. Ова свестраност произилази из његове изложености широком спектру текстуалних ресурса, што га чини вредним алатом за широк спектар корисника.

Прочитајте више о АИ:

Одрицање од одговорности

У складу са Смернице пројекта Труст, имајте на уму да информације дате на овој страници нису намењене и не треба да се тумаче као правни, порески, инвестициони, финансијски или било који други облик савета. Важно је да инвестирате само оно што можете приуштити да изгубите и да тражите независан финансијски савет ако сумњате. За додатне информације, предлажемо да погледате одредбе и услове, као и странице помоћи и подршке које пружа издавач или оглашивач. MetaversePost је посвећен тачном, непристрасном извештавању, али тржишни услови су подложни променама без претходне најаве.

О аутору

Дамир је вођа тима, менаџер производа и уредник у Metaverse Post, покривајући теме као што су АИ/МЛ, АГИ, ЛЛМ, Метаверсе и Web3-сродна поља. Његови чланци привлаче огромну публику од преко милион корисника сваког месеца. Чини се да је стручњак са 10 година искуства у СЕО и дигиталном маркетингу. Дамир се помиње у Масхабле, Виред, Cointelegraph, Тхе Нев Иоркер, Инсиде.цом, Ентрепренеур, БеИнЦрипто и друге публикације. Путује између УАЕ, Турске, Русије и ЗНД као дигитални номад. Дамир је стекао диплому физике, за коју верује да му је дало вештине критичког размишљања које су му потребне да буде успешан у свету интернета који се стално мења.

više чланака

Дамир је вођа тима, менаџер производа и уредник у Metaverse Post, покривајући теме као што су АИ/МЛ, АГИ, ЛЛМ, Метаверсе и Web3-сродна поља. Његови чланци привлаче огромну публику од преко милион корисника сваког месеца. Чини се да је стручњак са 10 година искуства у СЕО и дигиталном маркетингу. Дамир се помиње у Масхабле, Виред, Cointelegraph, Тхе Нев Иоркер, Инсиде.цом, Ентрепренеур, БеИнЦрипто и друге публикације. Путује између УАЕ, Турске, Русије и ЗНД као дигитални номад. Дамир је стекао диплому физике, за коју верује да му је дало вештине критичког размишљања које су му потребне да буде успешан у свету интернета који се стално мења.