GPT-4Lekkinud üksikasjad heidavad valgust selle tohutule ulatusele ja muljetavaldavale arhitektuurile

Põgusalt

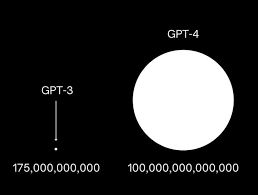

Lekkinud teave selle kohta GPT-4 on tekitanud AI kogukonnas elevust. Eelkäija omast üle 10 korra suuremate parameetritega GPT-3, GPT-4 on hinnanguliselt 1.8 triljonit parameetrit, mis on jaotatud 120 kihi peale.

OpenAI rakendas ekspertide segu (MoE) mudelit, kasutades 16 eksperti 111 miljardi parameetriga mitmekihiliste pertseptronide (MLP) jaoks. Mudeli tõhus järeldusprotsess kasutab 280 miljardit parameetrit ja 560 TFLOP-i edasipääsu kohta, mis näitab OpenAIon pühendunud tõhususe ja kulutasuvuse maksimeerimisele. Mudeli treeningandmete kogum sisaldab 13 triljonit žetoone, mille peenhäälestus on vahemikus 8 32 kuni XNUMX XNUMX.

OpenAI aastal kasutas paralleelsust GPT-4 et kasutada ära oma A100 GPU-de kogu potentsiaal, kasutades 8-suunalist tensoriparalleelsust ja 15-suunalist konveieri paralleelsust. Koolitusprotsess oli mahukas ja ressursimahukas ning kulud jäid vahemikku 32–63 miljonit dollarit.

GPT-4Järelduskulud on ligikaudu kolm korda kõrgemad kui tema eelkäijal, kuid see hõlmab ka mitme päringu tähelepanu, pidevat komplekteerimist ja spekulatiivset dekodeerimist. Järeldusarhitektuur töötab 128 GPU-st koosnevas klastris, mis on jaotatud mitme andmekeskuse vahel.

Hiljutine ümbritsevate detailide lekkimine GPT-4 on saatnud lööklaineid läbi AI kogukonna. Avaldamata allikast saadud lekkinud teave annab ülevaate selle murrangulise mudeli aukartust äratavatest võimalustest ja enneolematust mastaabist. Jagame faktid ja avalikustame peamised aspektid, mis seda teevad GPT-4 tõeline tehnoloogiline ime.

- GPT-4Massive Parameters Count

- Ekspertide segu mudel (MoE)

- Lihtsustatud MoE marsruutimisalgoritm

- Tõhus järeldus

- Ulatuslik koolitusandmekogum

- Täpsustage peenhäälestusega 8K-lt 32K-le

- Skaleerimine GPU-dega paralleelsuse kaudu

- Koolituskulud ja kasutamise väljakutsed

- Kompromissid ekspertide segus

- Järelduskulu

- Mitme päringu Tähelepanu

- Pidev partiide komplekteerimine

- Vision Multi-Modal

- Spekulatiivne dekodeerimine

- Järeldusarhitektuur

- Andmestiku suurus ja koostis

- Kuulujutud ja spekulatsioonid

- Reporteri arvamus

- Lummus koos GPT-4's Teadmised

- Mitmekülgsus GPT-4

GPT-4Massive Parameters Count

Üks silmatorkavamaid paljastusi lekkest on selle ulatus GPT-4. Sellel on hämmastav suurus, mille parameetrid on rohkem kui 10 korda suuremad kui tema eelkäijal, GPT-3. Hinnanguliselt on selle kogusumma hämmastavalt umbes 1.8 triljon parameetrit jaotatud muljetavaldava 120 kihi vahel. See mastaabi oluline suurenemine aitab kahtlemata kaasa GPT-4täiustatud võimalused ja potentsiaal murrangulisteks edusammudeks.

Ekspertide segu mudel (MoE)

Mõistlike kulude tagamiseks, säilitades samal ajal erakordse jõudluse, OpenAI aastal rakendas ekspertide segu (KKM) mudelit GPT-4. Kasutades mudelis 16 eksperti, millest igaüks koosneb ligikaudu 111 miljardist parameetrist mitmekihiliste pertseptronide (MLP) jaoks, OpenAI tõhusalt optimeeritud ressursside jaotamine. Märkimisväärne on see, et iga edasikäigu ajal suunatakse ainult kaks eksperti, minimeerides arvutusnõudeid ilma tulemusi kahjustamata. See uuenduslik lähenemine näitab OpenAIon pühendunud oma mudelite tõhususe ja kulutasuvuse maksimeerimisele.

Väga huvitav ja üksikasjalik leke GPT-4 arhitektuur koos selle taga olevate põhjenduste ja selle tagajärgede suurepärase analüüsiga – by @dylan522p :https://t.co/eHE7VlGY5V

— Jan P. Harry (@jphme) Juuli 11, 2023

Tasumata kokkuvõtte leiate siit: https://t.co/rLxw5s9ZDt

Lihtsustatud MoE marsruutimisalgoritm

Kuigi mudel uurib sageli täpsemaid marsruutimisalgoritme, et valida iga märgi käsitlemiseks eksperdid, OpenAI's lähenemine praeguses GPT-4 mudel on väidetavalt lihtsam. Väidetavalt on tehisintellekti kasutatav marsruutimisalgoritm suhteliselt lihtne, kuid sellegipoolest tõhus. Ligikaudu 55 miljardit jagatud tähelepanu parameetrit hõlbustavad žetoonide tõhusat jaotamist mudelis asjakohastele ekspertidele.

Tõhus järeldus

GPT-4Järeldusprotsess näitab selle tõhusust ja arvutusvõimet. Iga edasiminek, mis on pühendatud ühe märgi genereerimisele, kasutab ligikaudu 280 miljardit parameetrit ja 560 TFLOP-i (tera ujukomaoperatsiooni sekundis). See on teravas kontrastis selle tohutu ulatusega GPT-41.8 triljoni parameetriga ja 3,700 TFLOP-iga edasipääsu kohta puhtalt tihedas mudelis. Ressursside tõhus kasutamine tõstab esile OpenAIon pühendunud optimaalse jõudluse saavutamisele ilma liigsete arvutusnõueteta.

Ulatuslik koolitusandmekogum

GPT-4 on koolitatud kolossaalse andmekogumi kohta, mis sisaldab ligikaudu 13 triljonit žetoone. Oluline on märkida, et need märgid sisaldavad nii unikaalseid märke kui ka epohhinumbreid arvestavaid märke. The koolitusprotsess sisaldab kahte epohhi tekstipõhiste andmete jaoks ja nelja epohhi koodipõhiste andmete jaoks. OpenAI kasutas mudeli jõudluse täiustamiseks miljoneid ridu ScaleAI-st pärit ja sisemiselt saadud juhiste peenhäälestusandmeid.

Täpsustage peenhäälestusega 8K-lt 32K-le

Treeningueelne faas GPT-4 kasutas 8k konteksti pikkust. Seejärel tehti mudelit peenhäälestus, mille tulemuseks oli 32k versioon. See edasiminek põhineb koolituseelsel etapil, suurendades mudeli võimeid ja kohandades seda konkreetsete ülesannete jaoks.

Skaleerimine GPU-dega paralleelsuse kaudu

OpenAI aastal rakendas paralleelsuse jõudu GPT-4 oma A100 GPU-de täielikku potentsiaali ära kasutada. Nad kasutasid 8-suunalist tensori paralleelsust, mis maksimeerib paralleelset töötlemist, kuna see on NVLinki piir. Lisaks kasutati jõudluse edasiseks parandamiseks 15-suunalist torujuhtme paralleelsust. Kuigi tõenäoliselt kasutati spetsiifilisi tehnikaid, nagu ZeRo 1. etapp, jääb täpne metoodika avalikustamata.

Koolituskulud ja kasutamise väljakutsed

koolitus GPT-4 oli ulatuslik ja ressursimahukas ettevõtmine. OpenAI eraldas 25,000–100 päeva jooksul ligikaudu 90 100 A32 GPU-d, mis töötavad ligikaudu 36–1% MFU kasutusmääraga (kõige sagedamini kasutatav). Treeningprotsess tõi kaasa mitmeid tõrkeid, mistõttu tuli kontrollpunktidest sagedasi taaskäivitada. Kui hinnanguliselt on 100 dollar AXNUMX tunni kohta, koolituskulud ainuüksi selle jooksu puhul oleks see ligikaudu 63 miljonit dollarit.

Kompromissid ekspertide segus

Ekspertide kombinatsiooni mudeli rakendamine toob kaasa mitmeid kompromisse. Juhul kui GPT-4, OpenAI valis suurema arvu asemel 16 eksperti. See otsus peegeldab tasakaalu parimate kahjumitulemuste saavutamise ja erinevate ülesannete üldistavuse tagamise vahel. Rohkem eksperte saab esitada väljakutseid ülesannete üldistamise ja lähenemise osas. OpenAIvalikul treenida eksperdi ettevaatlikkus valik on kooskõlas nende pühendumusega usaldusväärsele ja tugevale jõudlusele.

Järelduskulu

Võrreldes oma eelkäijaga, 175 miljardi parameetriga Davinci mudeliga, GPT-4järelduskulu on ligikaudu kolm korda suurem. Selle lahknevuse võib seostada mitme teguriga, sealhulgas toetamiseks vajalike suuremate klastritega GPT-4 ja järeldamise käigus saavutatud madalam kasutamine. Eeldades, et 0.0049 A1,000 GPU puhul on ligikaudne kulu 128 dollarit 100 märgi kohta ja 0.0021 H1,000 GPU puhul 128 senti 100 märgi kohta. GPT-4 8k-ga. Need arvud eeldavad korralikku kasutust ja suuri partiide suurusi, mis on kulude optimeerimise olulised kaalutlused.

Mitme päringu Tähelepanu

OpenAI võimendab mitme päringu tähelepanu (MQA), mis on selles valdkonnas laialdaselt kasutatav tehnika GPT-4 samuti. MQA juurutamisel vajab mudel ainult ühte pead, vähendades oluliselt võtmeväärtuste vahemälu (KV cache) jaoks vajalikku mälumahtu. Vaatamata sellele optimeerimisele tuleb märkida, et 32k partii GPT-4 ei saa mahutada 40 GB A100 GPU-dele ja 8k on piiratud partii maksimaalse suurusega.

Pidev partiide komplekteerimine

Tasakaalu leidmiseks latentsusaja ja järelduskulude vahel OpenAI sisaldab nii muutuvaid partii suurusi kui ka pidevat partiide sisestamist GPT-4. See adaptiivne lähenemisviis võimaldab paindlikku ja tõhusat töötlemist, optimeerides ressursside kasutamist ja vähendades arvutuskulusid.

Vision Multi-Modal

GPT-4 tutvustab tekstikodeerija kõrval eraldi nägemiskodeerijat, mis hõlmab nende kahe vahelist tähelepanu. See Flamingot meenutav arhitektuur lisab juba muljetavaldavale 1.8 triljonile parameetrite arvule lisaparameetreid. GPT-4. Nägemismudel läbib eraldi peenhäälestuse, kasutades umbes 2 triljonit märki pärast ainult teksti eeltreeningu faasi. See nägemisvõime annab jõudu autonoomsed ained veebilehtede lugemiseks, piltide transkribeerimiseks ja videosisu tõlgendamiseks – see on hindamatu väärtus multimeediaandmete ajastul.

Spekulatiivne dekodeerimine

Huvitav aspekt GPT-4Järeldusstrateegia on spekulatiivse dekodeerimise võimalik kasutamine. See lähenemine hõlmab väiksema ja kiirema mudeli kasutamist mudel ennustuste loomiseks mitme märgi jaoks ette. Need ennustatud märgid sisestatakse seejärel suuremasse "oraakli" mudelisse ühe partiina. Kui väiksem mudeli ennustused joondada suurema mudeli kokkuleppega, saab koos dekodeerida mitu märgi. Kui aga suurem mudel lükkab mustandmudeli ennustatud märgid tagasi, jäetakse ülejäänud partiist kõrvale ja järeldamine jätkub ainult suurema mudeliga. See lähenemisviis võimaldab tõhusat dekodeerimist, aktsepteerides samal ajal väiksema tõenäosusega järjestusi. Väärib märkimist, et see spekulatsioon on praegu kontrollimata.

Järeldusarhitektuur

GPT-4Järeldusprotsess toimib 128 GPU-st koosnevas klastris, mis on jaotatud mitme andmekeskuse vahel erinevates kohtades. See infrastruktuur kasutab arvutusliku efektiivsuse maksimeerimiseks 8-suunalist tensori paralleelsust ja 16-suunalist torujuhtme paralleelsust. Iga sõlm, mis koosneb 8 GPU-st, mahutab ligikaudu 130 miljardit parameetrit. Mudeli suurus on 120 kihti, GPT-4 mahub 15 erinevasse sõlme, võimalik, et esimeses sõlmes on vähem kihte, kuna on vaja manuseid arvutada. Need arhitektuurilised valikud hõlbustavad suure jõudlusega järelduste tegemist, demonstreerides OpenAIon pühendunud arvutusliku efektiivsuse piiride nihutamisele.

Andmestiku suurus ja koostis

GPT-4 koolitati muljetavaldava 13 triljoni žetooniga, pakkudes talle ulatuslikku tekstikorpust, millest õppida. Treeningu ajal kasutatud teadaolevate andmekogumite põhjal ei saa aga arvesse võtta kõiki märke. Kuigi sellised andmestikud nagu CommonCrawl ja RefinedWeb annavad olulise osa sellest koolituse andmed, jääb osa žetoonidest, mida pole arvesse võetud ja mida sageli nimetatakse "salajasteks" andmeteks.

Kuulujutud ja spekulatsioonid

Nende avaldamata andmete päritolu kohta on tekkinud spekulatsioone. Üks kuulujutt viitab sellele, et see sisaldab sisu populaarsetelt platvormidelt, nagu Twitter, Reddit ja YouTube, rõhutades kasutajate loodud sisu võimalikku mõju kujundamisele. GPT-4teadmistebaas. Lisaks on oletusi selliste ulatuslike kogude kaasamise kohta nagu LibGen, miljonite raamatute hoidla, ja Sci-Hub, platvorm, mis pakub juurdepääsu paljudele teadustöödele. Arusaam, et GPT-4 oli väljaõpetatud kogu GitHubis, on levinud ka AI-entusiastide seas.

Reporteri arvamus

Kuigi kuulujutte on palju, on oluline suhtuda nendesse kuulujuttudesse ettevaatlikult. Koolitus GPT-4 võis palju kasu saada spetsiaalsest kolledžiõpikutest koosnevast andmekogumist. Selle andmestiku, mis hõlmab laia valikut kursusi ja aineid, oleks võinud hoolikalt käsitsi kokku panna. Kolledžiõpikud pakuvad struktureeritud ja kõikehõlmavat teadmistebaasi, mida saab edukalt kasutada keelemudeli koolitamiseks ja mida on lihtne tekstifailideks teisendada. Sellise andmestiku kaasamine võib jätta mulje, et GPT-4 on teadlik erinevatest valdkondadest.

Lummus koos GPT-4's Teadmised

Üks intrigeeriv aspekt GPT-4Koolitus on tema võime näidata konkreetsete raamatute tundmist ja isegi meelde tuletada unikaalseid identifikaatoreid sellistelt platvormidelt nagu Project Euler. Teadlased on püüdnud välja võtta päheõpitud osad raamatutest GPT-4 et saada ülevaade selle koolitusest, õhutades veelgi uudishimu mudeli sisemise töö vastu. Need avastused rõhutavad selle hämmastavat võimekust GPT-4 teabe säilitamiseks ja suuremahuliste keelemudelite muljetavaldavate võimaluste rõhutamiseks.

Mitmekülgsus GPT-4

Lai valik teemasid ja valdkondi, mis GPT-4 võib näiliselt tegeleda esitleb selle mitmekülgsust. Olgu selleks siis keerukatele arvutiteaduse küsimustele vastamine või filosoofilistesse debattidesse süvenemine, GPT-4Mitmekesise andmestiku koolitus annab sellele võimaluse suhelda erinevate domeenide kasutajatega. See mitmekülgsus tuleneb selle kokkupuutest suure hulga tekstiressurssidega, muutes selle väärtuslikuks tööriistaks paljudele kasutajatele.

Loe AI kohta lähemalt:

Kaebused

Vastavalt Usaldusprojekti juhised, pange tähele, et sellel lehel esitatud teave ei ole mõeldud ega tohiks tõlgendada kui juriidilist, maksu-, investeerimis-, finants- või muud nõuannet. Oluline on investeerida ainult seda, mida saate endale lubada kaotada, ja kahtluste korral küsida sõltumatut finantsnõu. Lisateabe saamiseks soovitame vaadata nõudeid ja tingimusi ning väljaandja või reklaamija pakutavaid abi- ja tugilehti. MetaversePost on pühendunud täpsele ja erapooletule aruandlusele, kuid turutingimusi võidakse ette teatamata muuta.

Umbes Autor

Damir on ettevõtte meeskonnajuht, tootejuht ja toimetaja Metaverse Post, mis hõlmab selliseid teemasid nagu AI/ML, AGI, LLM-id, Metaverse ja Web3-seotud väljad. Tema artiklid meelitavad igal kuul tohutut vaatajaskonda, üle miljoni kasutaja. Ta näib olevat ekspert, kellel on 10-aastane SEO ja digitaalse turunduse kogemus. Damirit on mainitud ajakirjades Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto ja muud väljaanded. Ta reisib digitaalse nomaadina AÜE, Türgi, Venemaa ja SRÜ vahel. Damir omandas bakalaureusekraadi füüsikas, mis on tema arvates andnud talle kriitilise mõtlemise oskused, mida on vaja pidevalt muutuval Interneti-maastikul edukaks saamiseks.

Veel artikleid

Damir on ettevõtte meeskonnajuht, tootejuht ja toimetaja Metaverse Post, mis hõlmab selliseid teemasid nagu AI/ML, AGI, LLM-id, Metaverse ja Web3-seotud väljad. Tema artiklid meelitavad igal kuul tohutut vaatajaskonda, üle miljoni kasutaja. Ta näib olevat ekspert, kellel on 10-aastane SEO ja digitaalse turunduse kogemus. Damirit on mainitud ajakirjades Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto ja muud väljaanded. Ta reisib digitaalse nomaadina AÜE, Türgi, Venemaa ja SRÜ vahel. Damir omandas bakalaureusekraadi füüsikas, mis on tema arvates andnud talle kriitilise mõtlemise oskused, mida on vaja pidevalt muutuval Interneti-maastikul edukaks saamiseks.