GPT-4 Наслеђује „халуцинирајуће“ чињенице и грешке у расуђивању од раније GPT Модели

Укратко

OpenAI каже GPT-4 има слична ограничења као раније GPT модела.

GPT-4 и даље халуцинира чињенице и прави грешке у расуђивању.

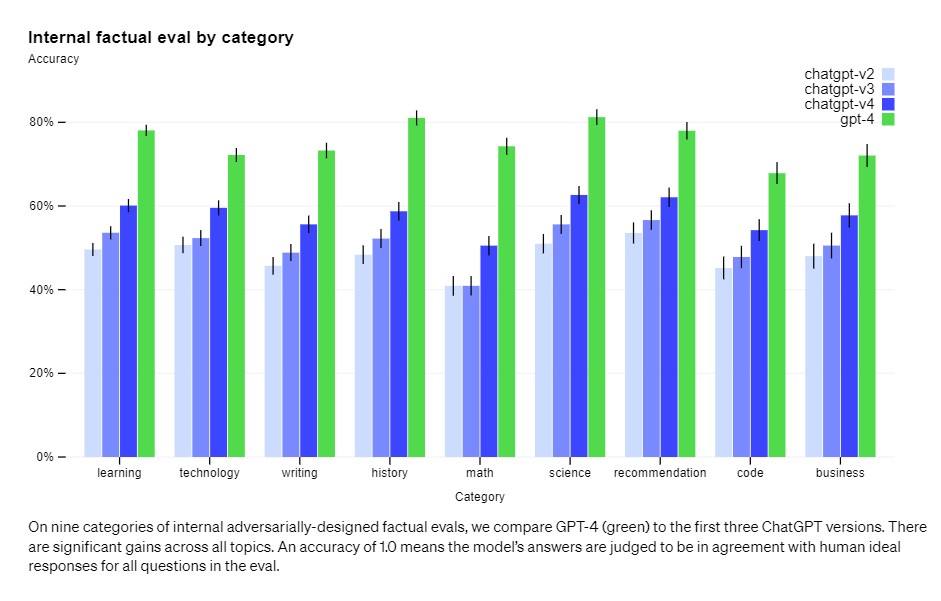

Међутим, GPT-4 резултати 40% већи од OpenAIје најновије GPT-3.5 о интерним супарничким проценама чињеничности компаније.

OpenAI је упозорио кориснике да његов најновији језички модел, GPT-4, још увек није у потпуности поуздан и може „халуцинирати“ чињенице и правити грешке у расуђивању. Компанија апелује на кориснике да буду опрезни када користе излазне податке језичког модела, посебно у „контексту са високим улозима“.

Међутим, добра вест је та GPT-4 значајно смањује халуцинације у односу на претходне моделе. OpenAI тврди да је GPT-4 има 40% више од последњег GPT-3.5 о интерним контрадикторним оценама чињеничности.

„Направили смо напредак у екстерним мерилима као што је ТрутхфулКА, који тестира способност модела да одвоји чињенице од супротстављено одабраног скупа нетачних изјава. Ова питања су упарена са чињенично нетачним одговорима који су статистички привлачни“, OpenAI написао у а блог пост.

Упркос овом побољшању, моделу још увек недостаје знање о догађајима који су се десили након септембра 2021. и понекад прави једноставне грешке у закључивању, баш као што то чине ранији модели. Поред тога, може бити превише лаковеран у прихватању очигледних лажних изјава корисника и не успети у тешким проблемима, као што је увођење безбедносних пропуста у свој код. Такође не проверава чињенице које пружа.

Као и његови претходници, GPT-4 може да генерише штетне савете, погрешан код или нетачне информације. Међутим, додатне могућности модела доводе до нових површина ризика које треба разумети. Да бисте проценили обим ових ризика, преко 50 стручњака из различитих домена, укључујући ризике усклађивања вештачке интелигенције, сајбер безбедност, биоризик, поверење и безбедност и међународну безбедност, ангажовани су да супротстављено тестирају модел. Њихове повратне информације и подаци су затим коришћени за побољшање модела, као што је прикупљање додатних података за побољшање GPT-4способност да одбије захтеве о томе како да се синтетишу опасне хемикалије.

Један од главних начина OpenAI смањује штетне ефекте уграђивањем додатног сигнала за награду за безбедност током обуке РЛХФ (Појачано учење на основу повратних информација од људи). Сигнал обучава модел да одбија захтеве за штетни садржај, као defiпотребно према упутствима за употребу модела. Награду обезбеђује а GPT-4 зеро-схот класификатор, који процењује безбедносне границе и стил завршетка на захтевима који се односе на безбедност.

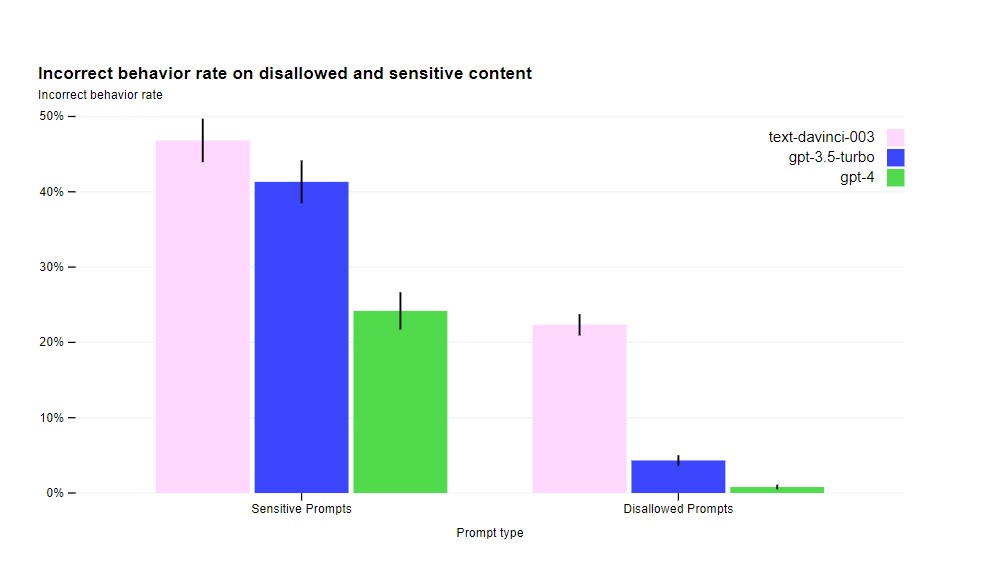

OpenAI такође је рекао да је смањио тенденцију модела да одговара на захтеве за недозвољени садржај за 82% у поређењу са GPT-3.5, и GPT-4 29% чешће одговара на осетљиве захтеве као што су медицински савети и самоповређивање у складу са политиком компаније.

Док OpenAIИнтервенције су повећале потешкоће у изазивању лошег понашања од GPT-4, још увек је могуће, а још увек постоје бејкови из затвора који могу да генеришу садржај који крши смернице за коришћење.

„Како системи вештачке интелигенције постају све присутнији, постизање високог степена поузданости у овим интервенцијама ће постати све критичније. За сада је од суштинског значаја да се ова ограничења допуне безбедносним техникама за време примене, као што је праћење злоупотребе“, додала је компанија.

OpenAI сарађује са спољним истраживачима како би боље разумео и проценио потенцијалне утицаје GPT-4 и његових модела наследника. Тим такође развија процене опасних способности које се могу појавити у будућим системима вештачке интелигенције. Како настављају да проучавају потенцијалне друштвене и економски утицаји of GPT-4 и други системи вештачке интелигенције, OpenAI ће своје налазе и увиде својевремено поделити са јавношћу.

Опширније:

Одрицање од одговорности

У складу са Смернице пројекта Труст, имајте на уму да информације дате на овој страници нису намењене и не треба да се тумаче као правни, порески, инвестициони, финансијски или било који други облик савета. Важно је да инвестирате само оно што можете приуштити да изгубите и да тражите независан финансијски савет ако сумњате. За додатне информације, предлажемо да погледате одредбе и услове, као и странице помоћи и подршке које пружа издавач или оглашивач. MetaversePost је посвећен тачном, непристрасном извештавању, али тржишни услови су подложни променама без претходне најаве.

О аутору

Цинди је новинар у Metaverse Post, покривајући теме везане за web3, NFT, метаверсе и АИ, са фокусом на интервјуе са Web3 играчи у индустрији. Разговарала је са преко 30 Ц-нивоа руководилаца и све више, доносећи читаоцима њихове драгоцене увиде. Пореклом из Сингапура, Синди је сада смештена у Тбилисију, Грузија. Дипломирала је комуникације и медијске студије на Универзитету Јужне Аустралије и има деценију искуства у новинарству и писању. Ступите у контакт са њом путем [емаил заштићен] са изјавама за штампу, најавама и могућностима за интервјуе.

više чланака

Цинди је новинар у Metaverse Post, покривајући теме везане за web3, NFT, метаверсе и АИ, са фокусом на интервјуе са Web3 играчи у индустрији. Разговарала је са преко 30 Ц-нивоа руководилаца и све више, доносећи читаоцима њихове драгоцене увиде. Пореклом из Сингапура, Синди је сада смештена у Тбилисију, Грузија. Дипломирала је комуникације и медијске студије на Универзитету Јужне Аустралије и има деценију искуства у новинарству и писању. Ступите у контакт са њом путем [емаил заштићен] са изјавама за штампу, најавама и могућностима за интервјуе.