8 ствари које треба да знате о великим језичким моделима

Укратко

Велики језички модели (ЛЛМс) се користе за истраживање нијанси природног језика, побољшање способности машина да разумеју и генеришу текст и аутоматизују задатке као што су препознавање гласа и машинско превођење.

Не постоји лако решење за управљање ЛЛМ-има, али они су једнако способни као и људи.

Са порастом развоја обраде природног језика и његове употребе у пословању, расте интересовање за велике језичке моделе. Ови модели се користе за истраживање нијанси природног језика, побољшање способности машина да разумеју и генеришу текст и аутоматизују задатке као што су препознавање гласа и машинско превођење. Ево осам основних ствари које треба да знате о великим језичким моделима (ЛЛМ).

- ЛЛМ су „способнији“ јер трошкови стално расту

- Брз поглед на то како GPT модели се прилагођавају како трошкови обуке расту

- ЛЛМ уче да играју друштвене игре користећи репрезентације спољашњег света

- Не постоји лако решење за управљање ЛЛМ

- Стручњаци имају проблема да објасне како ЛЛМ функционише

- ЛЛМ су једнако способни као и људи

- ЛЛМ морају бити више од обичног мајстора

- Модели су „паметнији“ него што људи мисле на основу првог утиска

ЛЛМ су „способнији“ јер трошкови стално расту

ЛЛМ-ови предвидљиво постају „способнији“ са повећањем трошкова, чак и без сјајних иновација. Овде је главна ствар предвидљивост, што је приказано у чланку о GPT-4: пет до седам малих модела је подучавано са буџетом од 0.1% коначног, а затим је направљено предвиђање за огроман модел на основу овога. За општу процену збуњености и метрике на подузорку једног специфичног задатка, такво предвиђање је било веома тачно. Ова предвидљивост је важна за предузећа и организације које се ослањају на ЛЛМ за своје пословање, јер могу да планирају у складу са тим и планирају будуће трошкове. Међутим, важно је напоменути да иако повећање трошкова може довести до побољшања способности, стопа побољшања може на крају да падне, због чега је неопходно улагати у нове иновације да би се наставило напредовање.

Брз поглед на то како GPT модели се прилагођавају како трошкови обуке расту

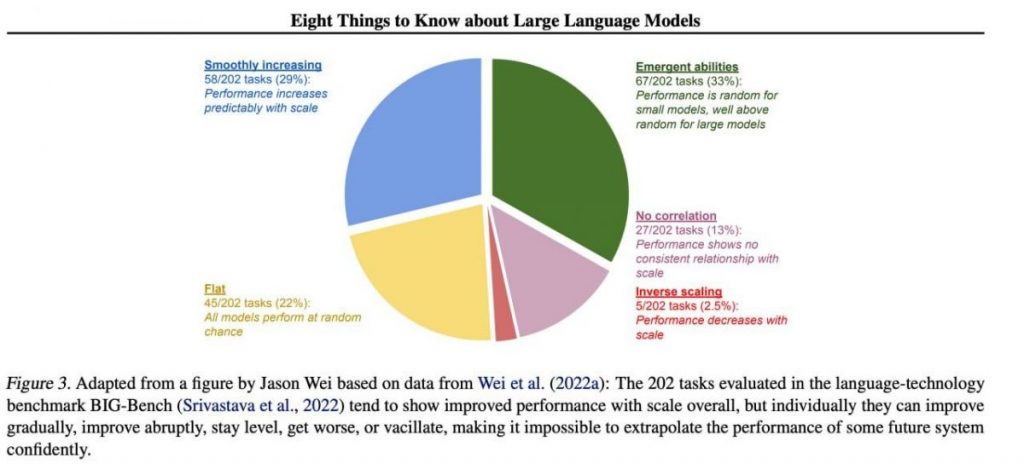

Међутим, специфичне важне вештине имају тенденцију да се појаве непредвидиво као нуспроизвод повећања трошкови обуке (дужа обука, више података, већи модел) — готово је немогуће предвидети када ће модели почети да обављају одређене задатке. Ову тему смо детаљније истражили у нашем чланак о историји развоја GPT модели. На слици је приказана дистрибуција повећања квалитета модела по различитим задацима. Само велики модели могу да науче да раде различите задатке. Овај графикон наглашава значајан утицај повећања величине GPT модела на њихов учинак у различитим задацима. Међутим, важно је напоменути да то долази по цену повећаних рачунарских ресурса и утицаја на животну средину.

ЛЛМ уче да играју друштвене игре користећи репрезентације спољашњег света

ЛЛМ често уче и користе репрезентације спољашњег света. Овде има много примера, а ево једног од њих: Обучени модели да играте друштвене игре на основу описа појединачних потеза, а да никада не видите слику терена за игру, научите интерне представе о стању табле при сваком потезу. Ове унутрашње репрезентације се тада могу користити за предвиђају будућност потезе и исходе, омогућавајући моделу да игра игру на високом нивоу. Ова способност учења и коришћења репрезентација је кључна аспект машинског учења и вештачка интелигенција.

Не постоји лако решење за управљање ЛЛМ

Не постоје поуздане методе за контролу понашања ЛЛМ. Иако је било одређеног напретка у разумевању и ублажавању различитих проблема (укључујући и ChatGPT GPT-4 уз помоћ повратних информација) не постоји консензус о томе да ли можемо да их решимо. Све је већа забринутост да ће ово постати огроман, потенцијално катастрофалан проблем у будућности када се створе још већи системи. Стога, истраживачи истражују нове методе како би осигурали да системи вештачке интелигенције буду усклађени са људским вредностима и циљевима, као што су усклађивање вредности и инжењеринг награђивања. Међутим, остаје изазован задатак да се гарантује сигурност и поузданост ЛЛМ-ова у сложеним сценаријима из стварног света.

Стручњаци имају проблема да објасне како ЛЛМ функционише

Стручњаци још не могу да протумаче унутрашње функционисање ЛЛМ. Ниједна техника нам не би дозволила да на било који задовољавајући начин наведемо које врсте знања, расуђивања или циљева модел користи када генерише било какав резултат. Овај недостатак интерпретабилности изазива забринутост у погледу поузданости и правичности одлука ЛЛМ-а, посебно у апликацијама са високим улозима као што су кривично право или кредитно бодовање. Такође наглашава потребу за даљим истраживањем о развоју транспарентнијих и одговорнијих АИ модела.

ЛЛМ су једнако способни као и људи

Иако су ЛЛМ обучени првенствено за опонашају људско понашање при писању текста, имају потенцијал да нас надмаше у многим задацима. То се већ види када се игра шах или Го. То је због њихове способности да анализирају огромне количине података и доносе одлуке на основу те анализе брзином којој људи не могу парирати. Међутим, ЛЛМ још увек немају креативност и интуицију коју људи поседују, што их чини мање погодним за многе задатке.

ЛЛМ морају бити више од обичног мајстора

ЛЛМ не смеју да изражавају вредности својих креатора или вредности кодиране у избору са Интернета. Не би требало да понављају стереотипе или теорије завере нити да покушавају да увреде било кога. Уместо тога, ЛЛМ би требало да буду дизајнирани тако да обезбеђују непристрасне и чињеничне информације својим корисницима уз поштовање културних и друштвених разлика. Поред тога, требало би да се подвргавају редовном тестирању и праћењу како би се осигурало да и даље испуњавају ове стандарде.

Модели су „паметнији“ него што људи мисле на основу првог утиска

Процене способности модела засноване на првом утиску су често погрешне. Врло често треба да смислите прави упит, предложите модел, а можда и покажете примере, и то ће почети много боље да се носи. То јест, „паметније“ је него што се чини на први поглед. Због тога је кључно дати моделу фер шансу и обезбедити му неопходне ресурсе за најбољи учинак. Уз прави приступ, чак и наизглед неадекватни модели могу нас изненадити својим могућностима.

Ако се фокусирамо на узорак од 202 задатка из скупа података БИГ-Бенцх (посебно је отежано тестирање језички модели од и до), тада по правилу (у просеку) модели показују повећање квалитета са повећањем обима, али појединачно, метрика у задацима може:

- побољшати постепено,

- драстично побољшати,

- остати непромењен,

- смањити,

- не показују никакву корелацију.

Све ово доводи до немогућности поуздане екстраполације перформанси било ког будућег система. Зелени део је посебно занимљив — управо ту показатељи квалитета нагло скачу без икаквог разлога.

Прочитајте више о АИ:

Одрицање од одговорности

У складу са Смернице пројекта Труст, имајте на уму да информације дате на овој страници нису намењене и не треба да се тумаче као правни, порески, инвестициони, финансијски или било који други облик савета. Важно је да инвестирате само оно што можете приуштити да изгубите и да тражите независан финансијски савет ако сумњате. За додатне информације, предлажемо да погледате одредбе и услове, као и странице помоћи и подршке које пружа издавач или оглашивач. MetaversePost је посвећен тачном, непристрасном извештавању, али тржишни услови су подложни променама без претходне најаве.

О аутору

Дамир је вођа тима, менаџер производа и уредник у Metaverse Post, покривајући теме као што су АИ/МЛ, АГИ, ЛЛМ, Метаверсе и Web3-сродна поља. Његови чланци привлаче огромну публику од преко милион корисника сваког месеца. Чини се да је стручњак са 10 година искуства у СЕО и дигиталном маркетингу. Дамир се помиње у Масхабле, Виред, Cointelegraph, Тхе Нев Иоркер, Инсиде.цом, Ентрепренеур, БеИнЦрипто и друге публикације. Путује између УАЕ, Турске, Русије и ЗНД као дигитални номад. Дамир је стекао диплому физике, за коју верује да му је дало вештине критичког размишљања које су му потребне да буде успешан у свету интернета који се стално мења.

više чланака

Дамир је вођа тима, менаџер производа и уредник у Metaverse Post, покривајући теме као што су АИ/МЛ, АГИ, ЛЛМ, Метаверсе и Web3-сродна поља. Његови чланци привлаче огромну публику од преко милион корисника сваког месеца. Чини се да је стручњак са 10 година искуства у СЕО и дигиталном маркетингу. Дамир се помиње у Масхабле, Виред, Cointelegraph, Тхе Нев Иоркер, Инсиде.цом, Ентрепренеур, БеИнЦрипто и друге публикације. Путује између УАЕ, Турске, Русије и ЗНД као дигитални номад. Дамир је стекао диплому физике, за коју верује да му је дало вештине критичког размишљања које су му потребне да буде успешан у свету интернета који се стално мења.