El nou model de text a imatge GigaGAN pot generar imatges 4K en 3.66 s

En breu

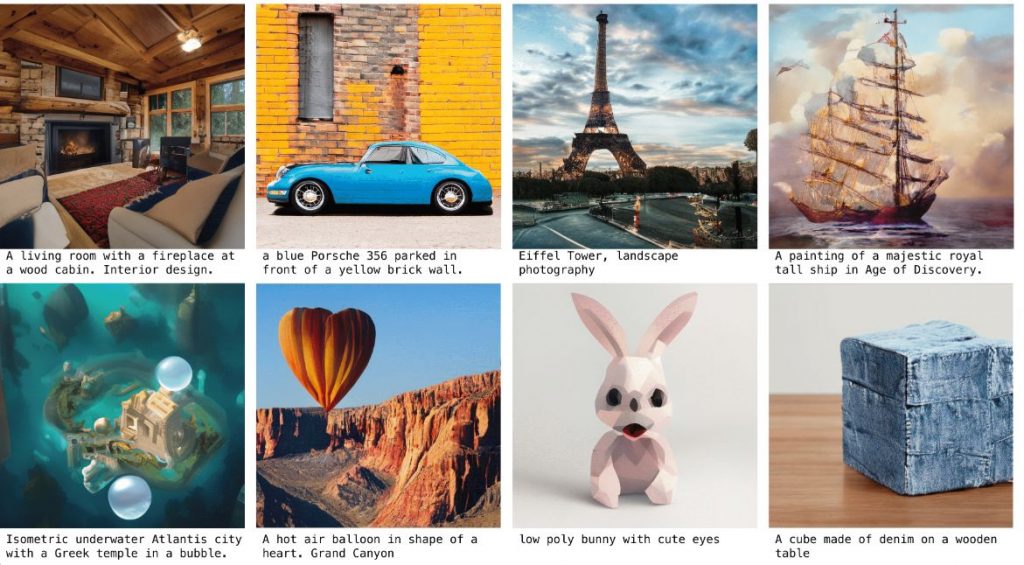

Els investigadors han desenvolupat un nou model de text a imatge anomenat GigaGAN que pot generar imatges 4K en 3.66 segons.

Es basa en el marc GAN (generative adversarial network), que és un tipus de xarxa neural que poden aprendre a generar dades similars a un conjunt de dades d'entrenament. GigaGAN és capaç de generar imatges de 512 px a 0.13 segons, 10 vegades més ràpid que el model d'última generació anterior, i té un espai latent desenredat, continu i controlable.

També es pot utilitzar per entrenar un mostrador eficient i de més qualitat.

Els investigadors han desenvolupat un nou model de text a imatge anomenat GigaGAN que pot generar 4K imatges en 3.66 segons. Aquesta és una millora important respecte als models de text a imatge existents, que poden trigar minuts o fins i tot hores a generar una sola imatge.

GigaGAN es basa en el marc GAN (generative adversarial network), que és un tipus de xarxa neuronal que pot aprendre a generar dades similars a un conjunt de dades d'entrenament. Els GAN s'han utilitzat per generar imatges realistes de cares, paisatges i fins i tot imatges de Street View.

El nou model s'ha entrenat en un conjunt de dades de 1 milions d'imatges, que és ordres de magnitud més gran que els conjunts de dades utilitzats per entrenar models anteriors de text a imatge. Com a resultat, GigaGAN és capaç de generar imatges de 512 píxels a 0.13 segons, que és més de 10 vegades més ràpid que el model anterior de text a imatge d'última generació.

A més, GigaGAN ve amb un espai latent desenredat, continu i controlable. Això vol dir que GigaGAN pot generar imatges que tenen una varietat d'estils diferents i que les imatges generades es poden controlar fins a cert punt. Per exemple, GigaGAN pot generar imatges que conserven la disposició de l'entrada de text, cosa que és important per a aplicacions, per exemple, quan es generen imatges de dissenys de productes a partir de descripcions de text.

GigaGAN també es pot utilitzar per entrenar un mostrador eficient i de més qualitat. Això es pot aplicar a imatges reals o a sortides d'altres models de text a imatge.

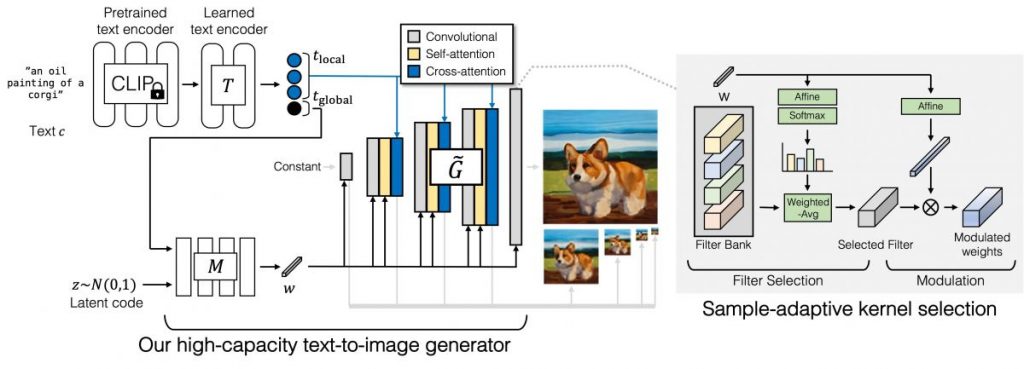

Una branca de codificació de text, una xarxa de mapeig d'estils, una xarxa de síntesi multiescala i una atenció estable i una selecció adaptativa del nucli formen part del generador GigaGAN. Els desenvolupadors comencen la branca de codificació de text extraient incrustacions de text amb un model CLIP prèviament entrenat i capes d'atenció apreses T. De manera similar a StyleGAN, la incrustació es passa a la xarxa de mapatge d'estil M, que genera el vector d'estil w. Per generar una piràmide d'imatge, la xarxa de síntesi ara utilitza el codi d'estil com a modulació i les incrustacions de text com a atenció. A més, els desenvolupadors introdueixen la selecció de nuclis de mostra adaptativa per seleccionar nuclis de convolució de manera adaptativa basant-se en el condicionament del text d'entrada.

El discriminador, com el generador, té dues branques per processar la imatge i el condicionament del text. La branca de text, com el generador, processa el text. La branca d'imatge rep una piràmide d'imatge i s'encarrega de fer prediccions independents per a cada escala d'imatge. A més, es fan prediccions a totes les escales de capes de reducció de mostreig posteriors. També s'utilitzen pèrdues addicionals per fomentar una convergència efectiva.

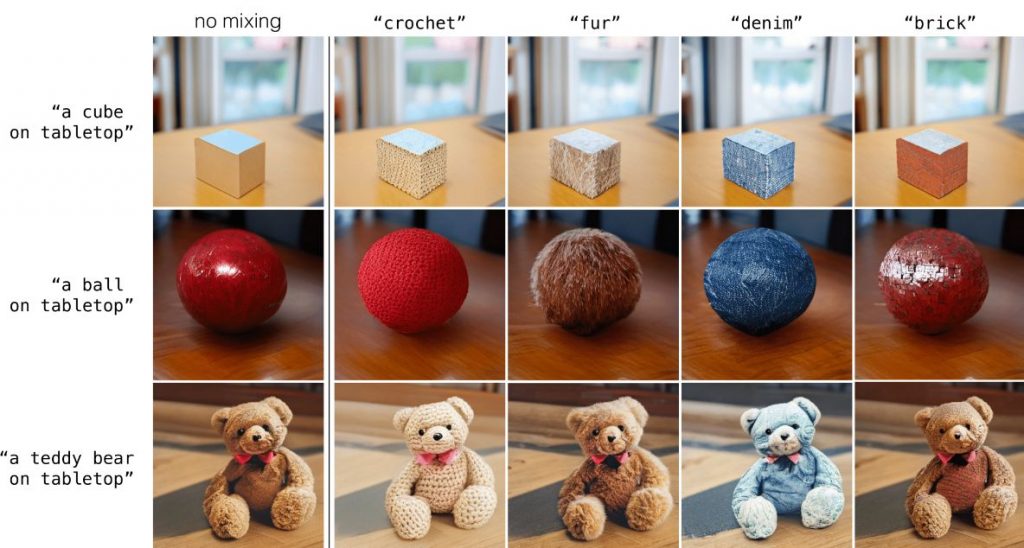

Tal com es mostra a la graella d'interpolació, GigaGAN permet una interpolació suau entre les indicacions. Les quatre cantonades es creen utilitzant la mateixa z latent però diferents indicacions de text.

Com que GigaGAN conserva un espai latent desenredat, els desenvolupadors poden combinar l'estil gruixut d'una mostra amb l'estil fi d'una altra. GigaGAN també pot controlar l'estil directament amb indicacions de text.

Llegeix més articles relacionats:

renúncia

En línia amb la Directrius del projecte Trust, si us plau, tingueu en compte que la informació proporcionada en aquesta pàgina no pretén ni s'ha d'interpretar com a assessorament legal, fiscal, d'inversió, financer o de cap altra forma. És important invertir només el que et pots permetre perdre i buscar assessorament financer independent si tens dubtes. Per obtenir més informació, us suggerim que feu referència als termes i condicions, així com a les pàgines d'ajuda i assistència proporcionades per l'emissor o l'anunciant. MetaversePost es compromet a fer informes precisos i imparcials, però les condicions del mercat estan subjectes a canvis sense previ avís.

About The Autor

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.

més articles

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.