StyleGAN-T: la generació de text a imatge més ràpida que produeix resultats en menys de 0.1 segons

En breu

StyleGAN-T és un nou GAN per a la generació d'imatges tex2.

Aquest GAN produeix bons resultats i fins i tot és bastant ràpid (0.1 segons per a una imatge de 512 × 512).

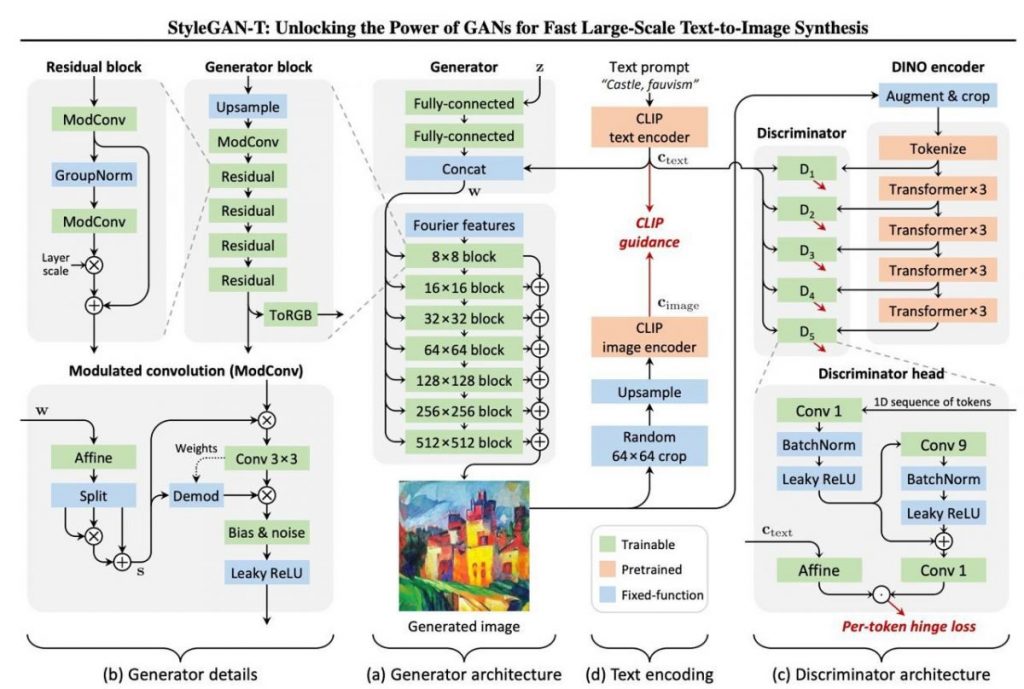

La nova arquitectura es basa en StyleGAN-XL, però reavalua els dissenys del generador i del discriminador.

Segur que us heu adonat que els GAN ja no es discuteixen quan apareix el tema de la generació d'imatges. Després de models de difusió com Stable Diffusion van sorgir, els GAN es van retirar d'alguna manera a un segon pla. Això es deu al fet que són difícils d'entrenar i sovint ensopeguen. L'únic avantatge dels GAN era que, a diferència dels models de difusió, produeixen una imatge en una sola tirada (una "passa endavant") en lloc de moltes tirades.

Però ara ha entrat al camp un nou jugador dels GAN: EstilGAN-T. Aquest GAN per a la generació de text a imatge produeix bons resultats ràpidament, ja que només triguen 0.1 segons per a una imatge de 512 × 512. La nova arquitectura es basa en StyleGAN-XL, però reavalua els dissenys del generador i del discriminador i utilitza CLIP per a l'alineació del text i els gràfics generats.

| Article relacionat: VToonify: un model d'IA en temps real per generar vídeos de retrats artístics |

En general, StyleGAN-T ara crea text a imatge més ràpid i amb més precisió que altres GAN. Tanmateix, GAN encara és horrible i la qualitat del model SD de mida completa està òbviament fora de dubte. Però tot dependrà de la capacitat de produir imatges d'alta qualitat a partir de text en menys d'un segon en un any. A més, es situarà entre GAN i el model de difusió.

Llegeix més sobre AI:

renúncia

En línia amb la Directrius del projecte Trust, si us plau, tingueu en compte que la informació proporcionada en aquesta pàgina no pretén ni s'ha d'interpretar com a assessorament legal, fiscal, d'inversió, financer o de cap altra forma. És important invertir només el que et pots permetre perdre i buscar assessorament financer independent si tens dubtes. Per obtenir més informació, us suggerim que feu referència als termes i condicions, així com a les pàgines d'ajuda i assistència proporcionades per l'emissor o l'anunciant. MetaversePost es compromet a fer informes precisos i imparcials, però les condicions del mercat estan subjectes a canvis sense previ avís.

About The Autor

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.

més articles

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.