Model d'IA de text a imatge

Què és el model d'IA de text a imatge?

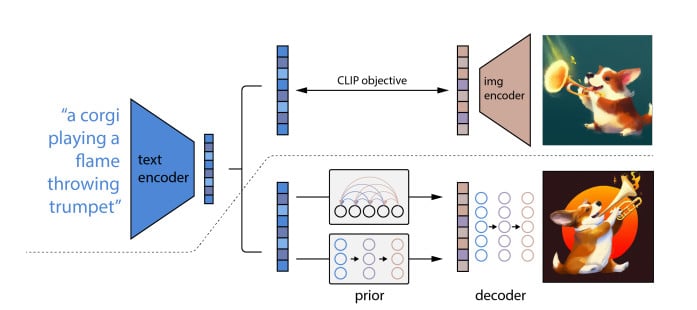

Un model de text a imatge és un tipus de màquina d'aprenentatge model que genera una imatge que correspon a una descripció en llenguatge natural proporcionada com a entrada. Els models de text a imatge solen consistir en dos components: un model d'imatge generatiu que crea una imatge condicionada al text d'entrada i un model de llenguatge que converteix el text en una representació latent. Normalment s'utilitzen grans volums de dades de text i imatges que es van treure d'Internet per entrenar els algorismes més eficients.

Comprensió del model d'IA de text a imatge

Els investigadors de la Universitat de Toronto van llançar alignDRAW, el primer model contemporani de text a imatge, el 2015. L'arquitectura DRAW que es va introduir per primera vegada va ser ampliada per alignDRAW per proporcionar condicionament de la seqüència de text. Tot i que les imatges generades per alignDRAW no tenien fotorrealisme i eren borroses, el model va demostrar que era capaç de més que "memoritzar" els continguts del conjunt d'entrenament en poder generalitzar-se a elements que no estaven inclosos en el conjunt d'entrenament i respondre correctament als noves pistes.

El OpenAI El sistema de transformació DALL-E va ser un dels primers models de text a imatge que va atraure un interès públic important, es va presentar el gener de 2021. L'abril de 2022, DALL-E 2, un reemplaçament que podria produir imatges més complexes i realistes, va ser presentat. L'agost del mateix any, Stable Diffusion es va posar a disposició del públic. L'agost de 2022 es va fer una demostració addicional de la "personalització" dels grans models de base de text a imatge. Amb la personalització de text a imatge, es pot ensenyar una nova noció al model amb un petit nombre de fotos d'un element que no era No forma part del conjunt d'entrenament del model de base de text a imatge, això s'aconsegueix mitjançant la inversió textual.

| connex: Millors 100+ Stable Diffusion Indicacions: les indicacions de text a imatge d'IA més boniques |

Futur del model d'IA de text a imatge

La comunitat creativa està explotant amb l'art d'IA, que ens està empenyent a un terreny inexplorat intel·lectual i artísticament. Tot i que encara s'estan explorant els seus aspectes creatius, ja ha començat a alterar l'entorn de la imatgeria artística. Les imatges humanes intel·ligents més enllà de qualsevol cosa que hem vist mai a una pantalla ja són benvingudes a la nostra ment. Un dels avenços més interessants és la creació de text a imatge, que permet als ordinadors produir imatges en resposta a ordres de text. Els artistes utilitzen la IA per ampliar la seva imaginació diàriament. Els seus interessos radiquen més en investigar la tecnologia per crear ciutats imaginàries, veure els gossos ballar en una discoteca o intentar esbrinar què els depara el futur.

Últimes notícies sobre el model d'IA de text a imatge

- Midjourney 5.2 i Stable Diffusion SDXL 0.9 ha publicat actualitzacions importants per a la generació d'imatges creatives. Midjourney 5.2 introdueix Zoom Out, variacions personalitzables i una transformació d'imatge 1:1. També introdueix Outpainting, variacions personalitzables i un analitzador de sol·licituds per optimitzar les indicacions i alinear-les amb les intencions dels usuaris. Aquestes actualitzacions milloren l'experiència de l'usuari i milloren la precisió en la generació d'imatges realistes.

- SnapFusion és un model d'IA que permet als usuaris crear imatges impressionants a partir de descripcions en llenguatge natural en només dos segons en dispositius mòbils. Elimina la necessitat de GPU cares i serveis basats en núvol, reduint costos i abordant els problemes de privadesa. L'eficiència i el rendiment del model s'han demostrat en experiments amb el conjunt de dades MS-COCO.

- Els investigadors han desenvolupat GigaGAN, un model de text a imatge que pot generar imatges 4K en 3.66 segons, una millora significativa respecte als models existents. GigaGAN es basa en el marc GAN i s'entrena en un conjunt de dades de 1 milions d'imatges, generant imatges de 512 píxels a 0.13 segons. Té un espai latent desenredat, continu i controlable, que permet diversos estils i control de la imatge. El model també pot entrenar un mostrador eficient per a imatges o sortides reals.

Últimes publicacions socials sobre

renúncia

En línia amb la Directrius del projecte Trust, si us plau, tingueu en compte que la informació proporcionada en aquesta pàgina no pretén ni s'ha d'interpretar com a assessorament legal, fiscal, d'inversió, financer o de cap altra forma. És important invertir només el que et pots permetre perdre i buscar assessorament financer independent si tens dubtes. Per obtenir més informació, us suggerim que feu referència als termes i condicions, així com a les pàgines d'ajuda i assistència proporcionades per l'emissor o l'anunciant. MetaversePost es compromet a fer informes precisos i imparcials, però les condicions del mercat estan subjectes a canvis sense previ avís.

About The Autor

Viktoriia és escriptora sobre diversos temes tecnològics, com ara Web3.0, IA i criptomonedes. La seva àmplia experiència li permet escriure articles per a un públic més ampli.

més articles

Viktoriia és escriptora sobre diversos temes tecnològics, com ara Web3.0, IA i criptomonedes. La seva àmplia experiència li permet escriure articles per a un públic més ampli.