Els grans models lingüístics actuals seran petits models, segons un investigador de OpenAI

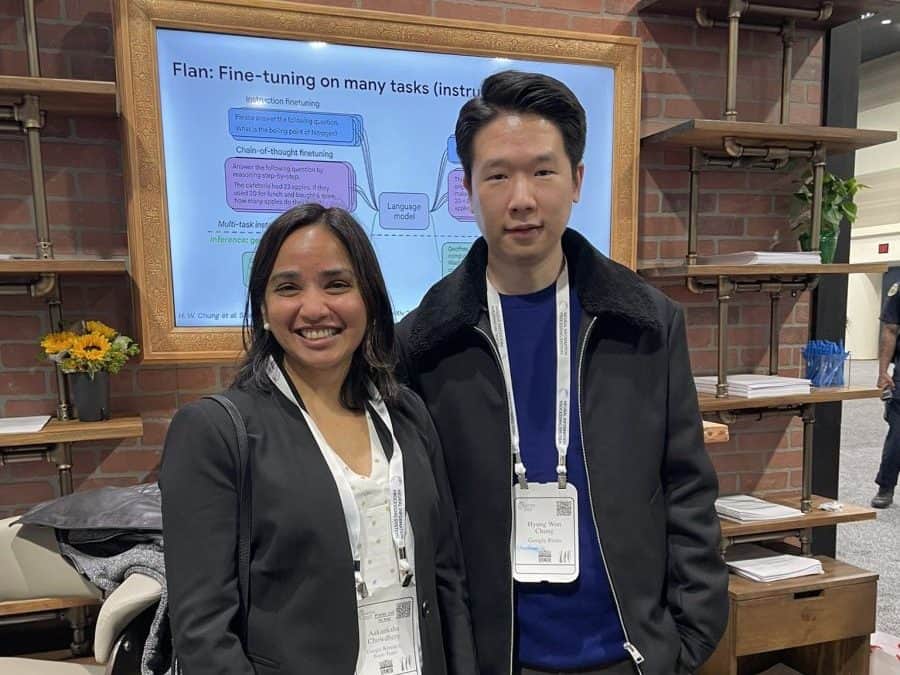

Hyung Won Chung, un excel·lent investigador d'IA que abans treballava per Google Brain i actualment és membre de la OpenAI equip, va pronunciar un discurs de 45 minuts que va provocar la reflexió en què va explorar el món dels grans models lingüístics el 2023. Chung té experiència en el camp; va ser el primer autor del paper de Google "Ampliació de models d'instrucció de llenguatge afinat,” que examina com es poden entrenar grans models de llenguatge per seguir instruccions.

Chung posa èmfasi en el món dels models lingüístics extensos com a dinàmic. En el món dels LLM, el principi rector està en constant evolució, en contrast amb els camps tradicionals on els supòsits fonamentals solen romandre estables. Amb la propera generació de models, el que actualment es considera impossible o poc pràctic pot ser possible. Subratlla la importància d'introduir la majoria de les afirmacions sobre les capacitats de LLM amb "per ara". Un model pot realitzar una tasca; simplement no ho ha fet encara.

Els models grans d'avui seran models petits en només uns anys

Hyung Won Chung, OpenAI

La necessitat d'una documentació meticulosa i reproductibilitat en Investigació en IA és una de les lliçons més importants que s'han d'aprendre del discurs de Chung. És crucial documentar a fons el treball en curs a mesura que es desenvolupa el camp. Aquesta estratègia garanteix que els experiments es puguin replicar i revisar ràpidament, permetent als investigadors basar-se en treballs anteriors. Mitjançant aquesta pràctica, es reconeix que es poden desenvolupar capacitats en el futur que no eren pràctiques durant la investigació inicial.

Chung dedica una part de la seva xerrada a dilucidar les complexitats de les dades i el paral·lelisme de models. Per a aquells que estiguin interessats a aprofundir en els aspectes tècnics de la IA, aquesta secció ofereix informació valuosa sobre el funcionament intern d'aquestes tècniques de paral·lelisme. Entendre aquests mecanismes és crucial per optimitzar-los formació de models a gran escala.

Chung planteja que la funció objectiu actual, la màxima probabilitat, que s'utilitza per a la formació prèvia a LLM és un coll d'ampolla quan es tracta d'aconseguir escales realment massives, com ara 10,000 vegades la capacitat de GPT-4. A mesura que avança l'aprenentatge automàtic, les funcions de pèrdua dissenyades manualment són cada cop més limitants.

Chung suggereix que el següent paradigma en el desenvolupament de la IA implica funcions d'aprenentatge mitjançant algorismes separats. Aquest enfocament, tot i que en la seva infància, té la promesa d'escalabilitat més enllà de les limitacions actuals. També destaca els esforços en curs, com ara Reinforcement Learning from Human Feedback (RLHF) amb Rule Modeling, com a passos en aquesta direcció, tot i que encara queden reptes per superar.

renúncia

En línia amb la Directrius del projecte Trust, si us plau, tingueu en compte que la informació proporcionada en aquesta pàgina no pretén ni s'ha d'interpretar com a assessorament legal, fiscal, d'inversió, financer o de cap altra forma. És important invertir només el que et pots permetre perdre i buscar assessorament financer independent si tens dubtes. Per obtenir més informació, us suggerim que feu referència als termes i condicions, així com a les pàgines d'ajuda i assistència proporcionades per l'emissor o l'anunciant. MetaversePost es compromet a fer informes precisos i imparcials, però les condicions del mercat estan subjectes a canvis sense previ avís.

About The Autor

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.

més articles

Damir és el líder d'equip, cap de producte i editor de Metaverse Post, que cobreix temes com AI/ML, AGI, LLMs, Metaverse i Web3-camps relacionats. Els seus articles atrauen una audiència massiva de més d'un milió d'usuaris cada mes. Sembla ser un expert amb 10 anys d'experiència en SEO i màrqueting digital. Damir ha estat esmentat a Mashable, Wired, Cointelegraph, The New Yorker, Inside.com, Entrepreneur, BeInCrypto i altres publicacions. Viatja entre els Emirats Àrabs Units, Turquia, Rússia i la CEI com a nòmada digital. Damir va obtenir una llicenciatura en física, que creu que li ha donat les habilitats de pensament crític necessàries per tenir èxit en el paisatge en constant canvi d'Internet.